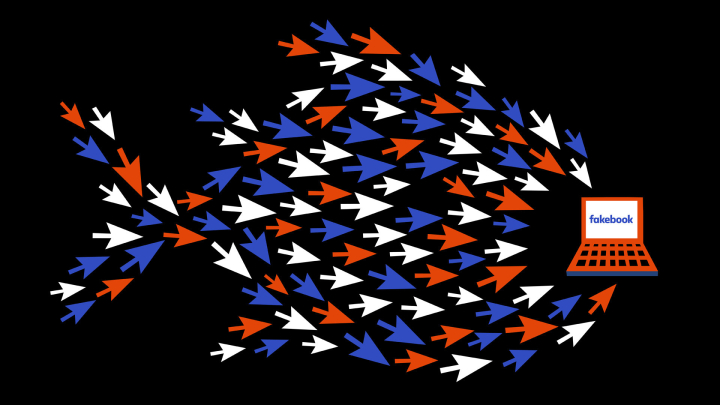

Wie Social Bots das Meinungsklima manipulieren

Bot-Accounts kapern soziale Medien wie Twitter, um dort politisch Stimmung zu machen

Vor ein paar Wochen gab es auf dem Kurznachrichtendienst Twitter ein interessantes Streitgespräch. Los ging es mit einem Tweet von User @prblbot: „Nazis schnallt den Fallschirm an – macht es so wie alle hier, mia san da, Niederbayern Antifa!“

Irgendwie wurde der Account @pegida2016 auf den Tweet aufmerksam und schrieb zurück: „IHR EXISTIERT NOCH? Was War [sic!] denn gestern los mit euch? 40 Leute mit refugees... Unsere Redner haben versucht euch zu animieren ;-)“

Die Reaktion von @prblbot ließ nicht lange auf sich warten: „Nieder mit dem Gerede von Angst, Zeit welche zu haben, deine Leibwächter zu schlagen mit Messern und Knarren.“

Dieser merkwürdige Satz wurde von @pegida2016 offenbar als Kampfansage aufgefasst, denn der nächste Tweet zurück lautete: „Wir sehen uns, Zecke“.

So ging es dann noch eine Weile weiter.

Nun ist der Austausch von Nettigkeiten zwischen Rechten und der Antifa nichts Besonderes. In diesem Fall aber doch: Denn @prblbot ist kein Mensch, sondern ein kleines Programm, das auf einem Algorithmus basiert – kurz: ein Bot. Das hat der Bot-Vater im Interview bestätigt. Der nötige Code dafür steht offen zugänglich auf der Coder-Plattform Github.

Die meisten Social Bots sind recht simpel gestrickt

„Ein Algorithmus ist ein Computerprogramm, das nach vordefinierten Abläufen eine Aufgabe erfüllt“, erklärt Jürgen Pfeffer. Pfeffer ist Professor für Computational Social Science und Big Data an der TU München und forscht über den Einfluss der kleinen Roboter-Helfer. Pfeffer sagt, dass die meisten Bots ziemlich simpel gestrickt seien: „Warte auf einen Tweet mit einem bestimmten Wort, wenn der kommt, like den Tweet – gib also dem Absender der Nachricht ein positives Feedback.“

„Warte auf einen Tweet mit einem bestimmten Wort, wenn der kommt, like den Tweet – gib also dem Absender der Nachricht ein positives Feedback“

Komplexere Bots können laut Pfeffer automatisch Internetseiten „lesen“ und jede neue Geschichte, die dort zu einem bestimmten Thema gepostet wird, automatisch weiterverbreiten. Und fortgeschrittene Bots können aus vorgegebenen Wörterbüchern sogar selbstständig mehr oder minder sinnvolle Texte dichten. Im Fall von @prblbot ist dieses Wörterbuch eine lose Sammlung von Antifa-Demo-Sprüchen der Plattform „Anarchopedia“ und Songzitaten, die dem Bot-Macher gefielen („Nazis schnallt den Fallschirm an“ stammt aus einem Lied von Rainald Grebe).

Dieses Rohmaterial kombiniert @prblbot dann mal mehr und mal weniger gut und schickt die Neuschöpfungen raus an seine mittlerweile gut 500 Follower. Seit seiner „Geburt“ im Frühling 2015 hat er so schon über 17.000 Tweets abgesetzt. Und ab und zu verwickelt er echte Menschen in absurde Mensch-Maschinen-Diskussionen.

Bots sind eine Gefahr für die Demokratie

Glaubt man Social-Media-Experten, dann könnten solche Unterhaltungen bald häufiger stattfinden, denn Social Bots sind eine schnell wachsende Bevölkerungsgruppe im Netz. Die beiden Forscher Emilio Ferrara und Alessandro Bassi von der University of Southern California haben in einem kurz vor der US-Präsidentschaftswahl veröffentlichten Aufsatz gezeigt, dass im Wahlkampf zwischen Donald Trump und Hillary Clinton fast 20 Prozent der politischen Kommunikation auf Twitter von Bots bestritten wurde.

Dabei war Donald Trumps Computer-Armee klar in der Mehrheit. Eine Snapshot-Analyse unter Leitung der Oxford University hat zutage gefördert, dass am Tag der Wahl auf einen Bot mit Pro-Clinton-Hashtag fünf Pro-Trump-Bots kamen. Bei einer Wahl, die so knapp ausging wie diese, ist also nicht auszuschließen, dass die republikanische Bot-Armee die Wahl mitentschieden haben könnte. Die Forscher warnen also nicht ganz zu Unrecht: Bots sind eine Gefahr für die Demokratie.

„Die entscheidende Frage ist, ob die Bots als Dienstleister oder als Manipulatoren eingesetzt werden“

Auch deutsche Experten sind besorgt. Andre Wolf ist Social-Media-Koordinator und Pressesprecher beim bekannten österreichischen Watchblog Mimikama. Mimikama ist so eine Art Verbraucherzentrale fürs Internet: Internetnutzer geben den Experten dort Hinweise auf fragwürdige Storys, die im Netz kursieren. Die Experten gehen den Geschichten dann auf den Grund und verkünden am Ende ein Ergebnis: wahr oder falsch.

Bei Bots ist die Sache allerdings ein bisschen komplizierter. „Nicht jeder Bot ist etwas Schlechtes“, sagt Wolf. „Die entscheidende Frage ist, ob die Bots als Dienstleister oder als Manipulatoren eingesetzt werden.“ Dienstleister sind politische Bots dann, wenn sie Inhalte von Parteien automatisch an Social-Media-Nutzer weiterverteilen oder wenn der CDU-Bot auf Nachfrage über das Programm der Partei aufklärt.

Bots behaupteten: #TrumpWon

Zu Manipulatoren werden Bots, wenn sie sich als normale Menschen ausgeben. Ein gutes Beispiel dafür kommt ebenfalls aus dem US-Wahlkampf. Ein Großteil der Medien und seriöse Umfragen waren sich nach allen drei US-Fernsehdebatten einig: Die Auftritte der demokratischen Kandidatin Hillary Clinton waren insgesamt deutlich überzeugender als die von Donald Trump. Soforumfragen in sozialen Netzwerken sahen das jedoch auffällig oft anders. Und auf Twitter trendete nach allen Debatten der Hashtag #TrumpWon – laut Experten ein Werk der Trump-Bots. Diese Steilvorlage aus dem Netz wiederum nutzte Trump, um sich als Sieger darzustellen.

„Social Bots können ein verzerrtes Bild der Realität aufbauen“

„Social Bots können ein verzerrtes Bild der Realität aufbauen“, sagt Andre Wolf. Und das kann schwerwiegende Folgen haben. Die Minderheit schreit so laut, dass die Mehrheit sich nichts mehr zu sagen traut oder nicht mehr will. Amerikanische Verhältnisse befürchtet Wolf im deutschsprachigen Raum nicht, zumindest noch nicht im Wahljahr 2017. Das liegt zum einen daran, dass die Politik nach Brexit und dem Wahlsieg von Donald Trump für das Thema sensibilisiert ist. Bundeskanzlerin Merkel hat vor kurzem vor der Gefahr von Fake-News und Social Bots gewarnt. Außerdem haben alle großen deutschen Parteien beschlossen, in diesem Wahlkampf auf den Einsatz von Social Bots zu verzichten.

Nur die AfD ziert sich noch ein bisschen. Im „Spiegel“ sagte AfD-Bundesvorstandsmitglied Alice Weidel im Oktober: „Selbstverständlich werden Social Bots in unserer Strategie im Bundestagswahlkampf bedacht werden.“ Gerade für junge Parteien seien Social-Media-Tools ein wichtiges Instrument. Erst nach massiver Kritik ruderte die AfD zurück und versprach, sie werde zumindest keine Social Bots einsetzen, „die auf Seiten Dritter im Namen der AfD automatisiert posten oder ähnliches.“

„Medien berichten gerne darüber, welche Themen online diskutiert werden oder welcher Politiker mehr Freunde auf Facebook hat“

Und noch ein Grund spricht dagegen, dass Social Bots im Bundestagswahlkampf 2017 einen großen Einfluss haben werden: Twitter, die Hauptspielwiese für Bots, wird in Deutschland nicht annähernd so viel genutzt wie in den USA. In Sicherheit wiegen können wir uns aber nicht, meint Informatikprofessor Pfeffer. „Medien berichten gerne darüber, welche Themen online diskutiert werden oder welcher Politiker mehr Freunde auf Facebook hat. Das alles beruht auf der Annahme, dass das Verhalten von Millionen Menschen diese Ergebnisse produziert. Aber vielleicht sehen wir hier gar nicht das Verhalten von vielen, sondern eher das Ergebnis der Manipulation von ganz wenigen.“

Maschinen können Bots besser enttarnen als Menschen

Das alles wäre nur halb so schlimm, wenn es leicht wäre, Bots zu enttarnen. Für Menschen ist das aber leider ziemlich schwierig – Maschinen können das um einiges besser. Bots jagt man also am besten mit anderen Bots. BotOrNot zum Beispiel ist eine Internetseite der Indiana University. Nutzer können dort einen Twitter-Namen eingeben. Dann geht das Programm eine Menge Kriterien durch, vom Profilbild über die Follower zu den Emotionen in den Tweets, und spuckt am Ende eine Wahrscheinlichkeit aus. Das klappt in vielen Fällen ganz gut, im Fall des Antifa-Bots @prblbot aber kommt auch das Universitätsprojekt zu einem falschen Schluss: Nur 20 Prozent Bot-Wahrscheinlichkeit.

Wichtig ist deshalb bei allem, was im Netz steht, vor allem eine gesunde Portion Skepsis, meint Informatikprofessor Pfeffer: „Wir wissen, dass nicht jedes Gerücht wahr ist, das wir im Wirtshaus hören. Ebenso wenig ist alles wahr, was auf Facebook steht. Und jetzt kommt eben noch hinzu, dass vieles, was wir im Internet sehen, nicht einmal von Menschen geschrieben worden sein muss.“ Oder einfacher ausgedrückt: „Glaub nicht alles, was du im Internet liest.“