Ist KI zu smart geworden?

Was genau ist Künstliche Intelligenz überhaupt? Haben Algorithmen Vorurteile? Und könnten sie irgendwann mal mächtiger werden als der Mensch? Das haben wir Clara Helming von Algorithm Watch gefragt

fluter.de: ChatGPT, Midjourney und DeepL sind inzwischen vielen ein Begriff, aber: Was genau ist Künstliche Intelligenz eigentlich?

Clara Helming: Der Begriff ist ungenau und hat keine klare Definition. Manche Leute – und zu denen gehöre ich – meinen damit komplizierte Software. Andere denken an Roboter, die die Menschheit auslöschen wollen, wie in einem Hollywoodfilm. Bei AlgorithmWatch verwenden wir daher den Ausdruck „algorithmische Systeme“. Das schließt viele Programme ein – angefangen bei großen Sprachbots wie ChatGPT mit vielen Anwendungsmöglichkeiten bis hin zu spezialisierten Anwendungen wie Programmen, die Krebszellen erkennen. In aktuellen Debatten um KI wird unter diesem Oberbegriff oft alles zusammengeworfen. Viele wissen nicht mehr genau, worum es geht, man stellt sich aber etwas radikal Neuartiges und Mysteriöses vor. Dabei ist sogenannte KI keine Zauberei. Vieles in unserem Alltag funktioniert bereits seit Jahren mit Algorithmen von KI, ohne dass darüber je öffentlich diskutiert wurde: WhatsApp schlägt uns Worte vor, um einen Satz zu vervollständigen, unser Smartphone erkennt Personen auf Fotos, unser Auto hat eine Einparkhilfe. KI ist nicht per se problematisch, sondern nur Anwendungen, die Entscheidungen über Menschen treffen oder Menschen schaden, zum Beispiel, wenn Bilder gefakt werden. Ein automatisiertes Mailpostfach ist im Vergleich harmlos.

Über welchen Aspekt von KI wird noch nicht genug gesprochen?

Über die Ungerechtigkeit, die durch algorithmische Systeme entstehen. Viele Menschen gehen davon aus, dass Maschinen neutrale Entscheidungen treffen. Doch das ist nicht der Fall. Auch sie werden von Menschen programmiert und eingesetzt. Die meisten Programmierer und Techunternehmer sind Männer und sitzen in den USA oder in anderen reichen Ländern. Sie haben spezifische Interessen und Vorstellungen von der Welt. Ihre Entscheidungen prägen von der Auswahl der Daten bis hin zur Programmierung der Algorithmen, wie die KI- Systeme funktionieren.

„Wenn in der Vergangenheit immer Männer für eine bestimmte Position ausgewählt wurden, ist es wahrscheinlich, dass auch das automatisierte Entscheidungssystem männliche Bewerber bevorzugt“

Haben Sie dafür ein Beispiel?

Viele Firmen setzen Algorithmen ein, um nach geeigneten Bewerber*innen für eine Stelle zu filtern. Wenn in der Vergangenheit immer Männer für eine bestimmte Position ausgewählt wurden und die KI mit diesen Daten trainiert wird, ist es wahrscheinlich, dass auch das automatisierte Entscheidungssystem männliche Bewerber bevorzugt. Obwohl die KI dazulernt, wird sie letztlich auch nur mit Daten gefüttert, die ein Mensch einspeist. Der Bias wird dabei übernommen. KI kann viel, ist aber nicht im menschlichen Sinne intelligent, sie hat keine Autonomie. Technologie und ihre Verwendung sind deshalb immer auch politisch, weil wir als Gesellschaft überlegen müssen, wie wir KI einsetzen wollen.

Mittlerweile wird auch über die Macht der großen Techunternehmen und der Männer an ihrer Spitze diskutiert.

Bestimmte Aspekte des politischen Diskurses sowie viele Lebensbereiche liegen in den Händen von Meta, Microsoft, Amazon und Apple. Es ist eine wichtige Aufgabe der Politik, Monopol- und Kartellbildung einzuschränken und Gegenmaßnahmen zu ergreifen.

Welche Maßnahmen gibt es denn, um Techunternehmen zu kontrollieren?

Die EU arbeitet derzeit an mehreren umfangreichen Gesetzesvorhaben zur Regulierung von KI-Unternehmen. Ein Beispiel ist das Europäische Gesetz über Künstliche Intelligenz: Hochrisiko-KI-Systeme müssen danach bestimmte Anforderungen bezüglich Transparenz oder Risikomanagement erfüllen, bevor sie auf den Markt gebracht werden dürfen. Systeme mit inakzeptablem Risiko, wie etwa die Live-Gesichtserkennung im öffentlichen Raum durch die Polizei, sollen ganz verboten werden. Im vergangenen Jahr wurde in der EU auch der Digital Services Act verabschiedet, das umfangreichste Gesetz zur Regulierung von Social-Media-Plattformen weltweit. Es verpflichtet große Internetplattformen wie Facebook oder YouTube dazu, mehr gegen die Verbreitung illegaler Inhalte zu tun. Das sind erste Fortschritte, wie effektiv die Gesetze aber wirklich sind, muss sich erst noch zeigen. Es drohen zwar Bußgelder, wenn sie dagegen verstoßen, doch hat die EU keine digitale Polizei, um zu kontrollieren, ob alle Techunternehmen die Vorschriften einhalten oder doch ein Schlupfloch finden.

„Bisher gibt es keine Beweise, dass KI mächtiger wird als Menschen“

Manche Forscher räumen KI das Potenzial ein, ein eigenes Bewusstsein zu entwickeln und als Superintelligenz die Menschheit zu ersetzen. Ist das realistisch?

Diese deterministische Erzählung kommt aus der Philosophie des Longtermismus. Sie besagt unter anderem, dass die Technologie immer mächtiger wird und letztendlich die Menschheit unterdrücken könnte. Es ist eher Science-Fiction als wissenschaftliche Erkenntnis. Die CEOs einiger großer Techunternehmen streuen den Mythos einer undurchdringbaren KI, um sie so abstrakt und undurchschaubar zu halten, dass man sich schnell überfordert fühlen kann. ChatGPT oder Bildgeneratoren wie Midjourney sind beeindruckend und können viel. Sie sind aber keine menschenähnliche Intelligenz, die autonom agiert und undurchschaubar ist, sondern ausgetüftelte und trainierte Autovervollständigung – programmiert von diesen Techkonzernen. Bisher gibt es keine Beweise, dass KI mächtiger wird als Menschen. Stattdessen sind schon heute reale Gefahren durch künstliche Intelligenz sichtbar. Darauf sollten wir uns konzentrieren.

Zum Beispiel?

Es gibt mittlerweile „KI-Sweatshops“ in vielen afrikanischen und asiatischen Ländern. Menschen sorgen dort unter äußerst schlechten Arbeitsbedingungen dafür, dass Modelle wie ChatGPT keine Hassrede oder illegale Inhalte generieren. In Kenia gibt es zum Beispiel den Job des Content-Moderators. Sie sichten stundenlang Videos von Enthauptungen oder schweren Beleidigungen und geben der KI Rückmeldung, dass es sich dabei um schlechte Inhalte handelt, um sie so zu trainieren, das selbst zu erkennen. Dafür bekommen sie kaum Lohn und keine psychologische Unterstützung. Unternehmen lagern diese Arbeitsprozesse bewusst an Orte aus, an denen Menschen wenig Geld haben und sich mit den unzumutbaren Arbeitsbedingungen zufriedengeben müssen. Außerdem ist bisher nicht klar, welche ökologischen Folgen KI hat. Wir wissen, dass die riesigen Rechenzentren viele Ressourcen benötigen, aber wie viel Energie sie genau verbrauchen, machen die Techunternehmen nicht transparent.

Sie dürfen kurz träumen. Wofür könnte man KI idealerweise anwenden?

Ich stelle mir eine Welt vor, in der Menschlichkeit und kreatives Schaffen im Mittelpunkt stehen. Technologie kommt dann allen Menschen gleichermaßen zugute.

Clara Helming studierte an der Universität Leipzig Politikwissenschaft und leitete die Kampagnenarbeit der Antikorruptionsorganisation abgeordnetenwatch.de. Seit April 2023 arbeitet Helming bei der NGO Algorithm Watch, die sich für die Stärkung der Demokratie durch KI einsetzt.

Portrait: Studio Monbijou, CC BY 4.0

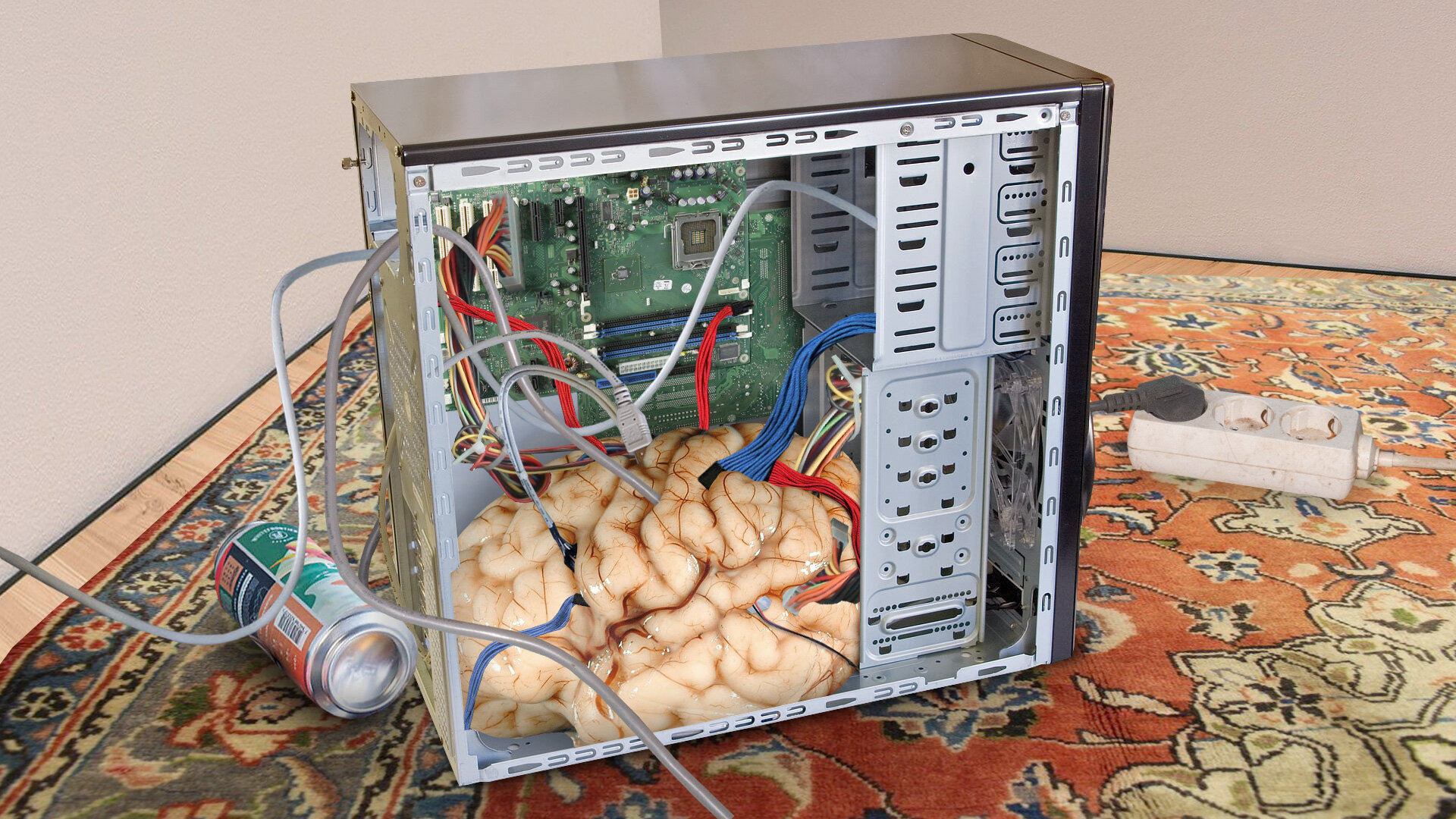

Illustration: Renke Brandt

Dieser Text wurde veröffentlicht unter der Lizenz CC-BY-NC-ND-4.0-DE. Die Fotos dürfen nicht verwendet werden.