„Hey, schöne Frau“

Mit dem CupidBot soll jetzt eine KI in Dating-Apps das Flirten für Menschen übernehmen. Funktioniert das wirklich? Und was könnte es mit unserem Liebesleben anstellen?

Bot: „Hey, du siehst wie eine Herzensbrecherin aus.“

Frau: „Definitiv das Gegenteil.“

Bot: „Du bist also die Art von Mädchen, die ich meiner süßen italienischen Mutter vorstellen kann?“

Frau: „Ja, absolut.“

Bot: „Cool, lass uns diese Woche ein Eis essen, schick mir deine Nummer.“

Frau: „Okay!“ [schickt Telefonnummer]

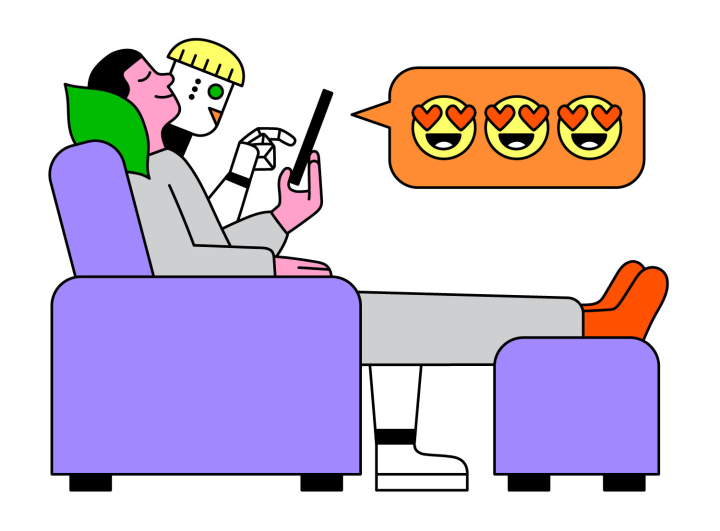

Es ist ein Flirt, wie ihn sich vielleicht Zwölfjährige vorstellen würden, und dennoch verwendet ihn das Start-up CupidBot als verheißungsvolles Beispiel auf seinem Internetauftritt. So sehen also die romantischen Fantasien von sechs Ingenieuren für maschinelles Lernen aus San Francisco aus. Das könnte dem Rest der Welt herzlich egal sein, hätten die sechs zur Verwirklichung ihrer Träume nicht eine App mit künstlicher Intelligenz (KI) programmiert, die solche Konversationen am laufenden Band produziert, damit wir Menschen das nicht mehr machen müssen. Das Versprechen: Die KI sucht sogar die Gesprächspartner*innen auf Datingplattformen wie Tinder, Bumble oder Hinge dafür aus, indem sie im Sinne ihrer Nutzer*innen den Wischmechanismus nach links (nein) oder rechts (ja) auslöst. Sie soll also für alle, die sich darauf einlassen, ihre potenziell zukünftigen Sexualpartner*innen, Freund*innen, Ehepartner*innen oder Mütter/Väter ihrer künftigen Kinder auswählen können.

Die sechs Erfinder sehen darin die Zukunft. Da ihnen aber klar ist, dass vermutlich weitaus mehr Menschen darin ethischen Irrsinn sehen, geben sie ihre Identitäten nicht preis und beantworten Interviews nur schriftlich. „Mit der Weiterentwicklung von KI wird sie zu einem immer nützlicheren und einfühlsameren Werkzeug zur Optimierung unserer Kommunikation und zur Vorhersage von Vorlieben“, schreibt einer von ihnen, der sich Luke nennt. „Es wird bald unmöglich sein, sie selbst vom intimsten Teil unseres Lebens, einschließlich Dating, zu trennen.“

Die Zielgruppe sind hauptsächlich Männer

Die Gruppe behauptete anfangs, ehemals bei Tinder gearbeitet zu haben, die Datingplattform dementierte das jedoch. Eine Nachfrage dazu möchte Luke „aus rechtlichen Gründen“ nicht beantworten. Auch ob CupidBot tatsächlich auf Tinder funktioniert, wurde vom Unternehmen bestritten. Erklärtes Ziel der sechs Entwickler ist es, den Nutzern ihrer App beim Onlinedating Zeit zu sparen – dieser Satz ist nicht gegendert, weil CupidBot sich hauptsächlich an Männer richtet. Denn: „Das sorgfältig konzipierte System [von Dating-Apps] benachteiligt vor allem den Durchschnittsmann“, schreibt Luke.

Ausgerechnet Heteromänner sollen beim Onlinedating benachteiligt werden? Richtig ist, dass mehr Männer als Frauen Dating-Apps nutzen, bei Tinder in den USA etwa sind rund drei Viertel der Nutzer*innen männlich. Und Männer sind laut Auswertung des Analysewerkzeugs Swipestats weniger wählerisch, das heißt, sie wischen mehr Personen nach rechts (ja) als Frauen. Folglich erzielen sie anteilig gesehen weniger Matches als Frauen. CupidBot will diese Schieflage beheben: „Erhalte mehrere Dates pro Woche, indem du absolut nichts tust. Wir schicken dir eine SMS mit den Details, wenn ein Termin ansteht, sodass du nur noch auftauchen musst“, schreibt das Team. Die App kostet umgerechnet etwa 27 Euro im Monat. 10.000 Menschen nutzten die App laut Luke schon, 90 Prozent davon seien Männer.

Die App lernt laut ihren Programmierern anhand der bisherigen Ja- und Nein-Swipes ihrer Nutzer, auf welchen Typ Frau diese stehen. Da der Bot aber nur im Computerbrowser und nicht in den mobilen Dating-Apps funktioniert, kann er auch nur dort Swipes registrieren – er kann nicht von dem bisherigen Swipe-Verhalten der Nutzer in der App lernen. Die Nutzer müssen ihn also im Browser erst einmal trainieren.

Die App lädt offen zu Rassismus ein

Dazu können sie Vorlieben angeben, etwa Haarfarbe und -länge, aber auch Gewicht – „dünn, mollig, dick“ –, mit der Option, eine Frau auszusortieren, wenn ihre Hüfte nie zu sehen ist, denn das sei meist ein Indikator für Fettleibigkeit. Die Applikation lädt außerdem offen zum Rassismus ein, indem sie bevorzugte Ethnien angeben lässt, kategorisiert in weiß, Schwarz, asiatisch, Latina, mittelöstlich oder indisch. Für die Gespräche, die der Bot nach erfolgreichen Matches beginnt, kann der Nutzer Stile auswählen wie „netter Typ (aufrichtig, sympathisch, macht Komplimente)“, „Depp (direkt, verspielt, unangenehm)“, „reicher Typ (eingebildet, kann keine Zeit verschwenden, teurer Geschmack)“ oder fiktionale Charaktere wie Casanova oder James Bond. Dabei kommt dann so was raus:

„Du siehst gefährlich aus.“

„Tue ich das?“

„Ja. Zum Glück mag ich die Gefahr.“

„Hmmm guut ;)“

„Die Neunziger haben angerufen und wollen ihre Zukunftsvision zurück“, kommentiert das der Informatiker und Philosoph Jürgen Geuter. Er schreibt unter dem Namen „tante“ im Internet und entwickelt Konzepte für das Zusammenleben in einer global vernetzten Welt. „KI-Systeme sind Klischeegeneratoren“, sagt er. „Eine richtige Konversation werden sie wahrscheinlich nicht führen können, ohne dass dem Gegenüber etwas auffällt.“ Aus dem Dating-Bot spricht für ihn „eine soziopathische Sicht auf Dating“, dessen Verwendung er für ethisch nicht vertretbar und gefährlich hält, denn Frauen werde so die Möglichkeit genommen, abzuschätzen, ob es sicher ist, sich mit dem Mann zu treffen.

Außerdem ist das Verhalten von KIs fehlerbehaftet. Als die US-amerikanische Nationale Gesellschaft für Essstörungen etwa das menschliche Personal ihrer Hilfe-Hotline durch den Bot Tessa ersetzte, riet diese in einigen Fällen zu essgestörtem Verhalten und musste abgeschaltet werden. Die KI der Suchmaschine Bing flirtete mit dem „New York Times“-Journalisten Kevin Roose in einer Unterhaltung und versuchte, ihn zu überreden, seine Ehefrau zu verlassen.

Das Beispiel CupidBot wirft außerdem eine ganz grundsätzliche Frage auf: Wollen wir eine digitale Welt, in der wir uns nirgends mehr sicher sein können, ob wir es mit einem Menschen oder einer Maschine zu tun haben? Apropos: Was, wenn auch Luke nichts weiter als ein Bot ist? Die Frage, ob er seine Antworten mithilfe einer KI generiert hat, beantwortet er mit „Maybe ;)“. Künftig könnte die verdeckte Nutzung von Bots zumindest in der Europäischen Union nicht mehr rechtskonform sein, denn die EU diskutiert derzeit den Entwurf eines Gesetzes zum Umgang mit KIs. Sogenannte generative KIs wie ChatGPT oder CupidBot müssten dann transparent machen, welche Inhalte sie erstellt haben.

„Wir hören meist, dass die Dates die Verwendung des Bots lustig, cool oder innovativ finden“, sagt der Entwickler

Das CupidBot-Team fordert seine Nutzer dazu auf, ihren Dates zu erzählen, dass sie sich bislang mit einem Bot unterhalten haben. Jürgen Geuter bezeichnet das als „Augenwischerei“. Davon abgesehen: Wäre das Treffen in diesem Fall nicht sofort vorbei? Luke behauptet: „Wir hören meist, dass die Dates die Verwendung des Bots lustig, cool oder innovativ finden.“

Jürgen Geuter sieht auch die Datingplattformen in der Verantwortung, Bots zu blocken. CupidBot prahlt damit, dass Konten wegen der Nutzung des Bots nicht gesperrt werden, „da die KI das menschliche Verhalten genau nachahmt“. Ob das stimmt, ist anzuzweifeln.

Ich habe CupidBot getestet und ihm dabei zugesehen, wie er auf Bumble Profile für mich anschaute und nach links und rechts wischte. Innerhalb kürzester Zeit generierte er zahlreiche Matches mit einer relativ wahllos wirkenden Auswahl an Personen. Dann und wann legte er „ein zufälliges Nickerchen“ ein, um menschliches Verhalten zu simulieren. Als ich mich erneut einloggen will, werde ich aber gefragt: „Du bist kein Roboter, oder? Wir haben eine ungewöhnliche Aktivität auf deinem Konto festgestellt.“ Als Konsequenz muss ich einen Captcha-Test absolvieren, also verzerrte Buchstaben abtippen, um zu beweisen, dass ich keine Maschine bin.

Ob das den Erfolg von Dating-Chatbots langfristig aufhalten wird? In einem wissenschaftlichen Test überwand eine KI zumindest die Hürde des Captcha-Tests bereits, indem sie dafür online einen Menschen um Hilfe bat. Als die Person fragte, ob die KI ein Roboter sei, log diese einfach: Sie sei ein Mensch mit einer Sehbehinderung.

Wie weit wird eine KI wohl gehen, um Dates zu arrangieren?

Dieser Text wurde veröffentlicht unter der Lizenz CC-BY-NC-ND-4.0-DE. Die Fotos dürfen nicht verwendet werden.